/ O que é IA generativa em segurança cibernética?

O que é IA generativa em segurança cibernética?

A IA generativa em segurança cibernética é uma ferramenta poderosa tanto para defensores quanto para invasores. A GenAI aciona grandes modelos de linguagem (LLMs) que podem ajudar as equipes de segurança a melhorar as políticas, a detecção de ameaças, o gerenciamento de vulnerabilidades e a postura geral de segurança. No entanto, ela também pode ajudar os cibercriminosos a lançar ataques mais rápidos e perigosos.

O que é IA generativa e como ela se relaciona com a cibersegurança?

A inteligência artificial generativa (GenAI) influencia o cenário de segurança cibernética de muitas maneiras importantes. No entanto, antes de nos aprofundarmos nisso, precisamos explicar o que é e seus casos de uso. Em essência, a IA generativa é um tipo de tecnologia de aprendizado de máquina que pode produzir conteúdo escrito em linguagem natural, imagens e, em alguns casos, vídeos; às vezes com apenas uma contribuição humana mínima.

Para a maioria dos casos de uso da GenAI, um usuário humano deve solicitar que o mecanismo de IA crie o conteúdo em questão, com algumas exceções para tecnologias empresariais avançadas. Por exemplo, uma pessoa pode digitar “Escreva uma história sobre um ataque cibernético de GenAI” em um gerador de prompt de texto, e o LLM produzirá rapidamente essa história. O mesmo vale para imagens: diga a um gerador de imagens de IA para “criar uma imagem de um data center futurista”, e ele fará exatamente isso.

A GenAI possibilita uma série de casos de uso para profissionais de qualquer setor, ajudando usuários comuns a abrir novos caminhos e aumentar a eficiência em termos de criação de conteúdo. Dito isso, para os propósitos deste artigo, analisaremos a IA generativa apenas no que se refere à segurança cibernética.

Como a IA generativa pode ser usada em segurança cibernética?

A IA generativa pode ser usada para auxiliar em esforços de segurança cibernética defensivos e ofensivos. As organizações podem implantar plataformas de GenAI em segurança cibernética para:

- Proteger dados sigilosos de forma ainda mais eficaz: evite vazamentos de dados e mantenha os prompts de IA e a saída de aplicativos de IA para segurança e auditorias.

- Fortalecer a segurança contra ameaças emergentes: adquira uma postura de segurança mais proativa, pois a IA ajuda a detectar e bloquear ataques emergentes baseados na web e em arquivos.

- Garantir o uso seguro de ferramentas como o ChatGPT: obtenha controle granular sobre o uso de aplicativos de IA com a capacidade de definir políticas diferentes para usuários diferentes.

- Limitar ações de risco em aplicativos de IA: evite ações que colocam os dados em risco, como uploads, downloads e uso da área de transferência.

Quais são as implicações da IA na segurança cibernética?

O uso do ChatGPT aumentou 634% (abril de 2023 a janeiro de 2024), o que significa que sua influência se estenderá a mais setores, incluindo segurança cibernética. Com o cerne da segurança cibernética baseado no conteúdo (ou seja, potenciais ameaças e ataques cibernéticos vindos do tráfego da web, e-mails, etc.), grandes modelos de linguagem serão preparados para analisar informações sobre tráfego e e-mails para ajudar as empresas a prever e prevenir eventos cibernéticos.

Dito isso, as equipes de segurança precisarão estar preparadas para combater o fogo com fogo. Os agentes e grupos criminosos também usarão a GenAI para obter vantagem contra as defesas cibernéticas das organizações. De acordo com a Microsoft, os ataques cibernéticos gerados por IA são de “estágio inicial” e “nem particularmente novos (nem) únicos”. Em um esforço para frustrar esses agentes, a OpenAI está encerrando suas contas, mas como o número de grupos criminosos continua a crescer, essas contas serão mais difíceis de rastrear e encerrar.

Além disso, é apenas uma questão de tempo até que os governos mundiais intervenham e estabeleçam diretrizes para o uso da GenAI em nível organizacional. Por enquanto, ainda há muito que se desconhece no que diz respeito à GenAI, mas, eventualmente, uma violação ou vazamento de dados pode ocorrer e custar milhões de dólares a uma empresa ou empresas, forçando o governo a intervir e regulamentar.

Aplicações reais de IA generativa em cibersegurança

A GenAI tem diversos casos de uso quando se trata de detecção e resposta a ciberameaças, automações de segurança e muito mais.

Detecção e resposta a ameaças aprimoradas

A IA generativa pode analisar dados que representam comportamento “normal” para definir uma base de referência pela qual identificar desvios que indicam ameaças potenciais. Além disso, a IA pode gerar simulações de malware para entender seu comportamento e identificar novas ameaças.

Capacidades preditivas aprimoradas

A IA generativa pode assimilar grandes quantidades de dados para criar um referêncial para futuros eventos de segurança, oferecendo inteligência preditiva de ameaças e até mesmo gerenciamento de vulnerabilidades.

Automação de tarefas repetitivas

A GenAI pode prever vulnerabilidades e recomendar ou automatizar correções para aplicativos com base em dados históricos referentes a esses aplicativos. Ela também pode automatizar a resposta a incidentes, reduzindo a necessidade de intervenção humana.

Prevenção de phishing

A GenAI pode auxiliar na criação de modelos que detectam e filtram e-mails de phishing, analisando padrões e estruturas de linguagem para identificar e-mails que tentam disfarçar a linguagem. Ela também pode criar modelos para analisar e bloquear URLs maliciosos.

Desafios e riscos da integração com a IA generativa

A GenAI oferece um potencial sem precedentes para criação de conteúdo e eficiência organizacional em geral, mas também é importante entender os obstáculos da tecnologia.

Abuso por criminosos cibernéticos

As ferramentas de GenAI estão disponíveis publicamente para qualquer pessoa, e enquanto organizações bem-intencionadas as usarão para aumentar a eficiência ou melhorar a segurança cibernética, criminosos as usarão da mesma forma para causar danos. A Microsoft e a OpenAI já descobriram tentativas de grupos criminosos de “organizar operações cibernéticas ofensivas”.

Problemas de qualidade de dados

Organizações que não conseguem fornecer dados de alta qualidade para treinar uma plataforma de IA sofrerão com a falta de eficácia em termos dos resultados obtidos com o uso da plataforma. Além disso, se uma empresa tentar treinar uma plataforma de GenAI usando dados criados pela GenAI, os dados resultantes serão ainda mais distorcidos; uma receita para o desastre quando se trata de segurança cibernética.

Limitações técnicas

Modelos de IA generativa exigem grandes quantidades de dados para serem treinados de forma eficaz. Dessa forma, empresas com acesso limitado a dados (ou aquelas em nichos de mercado) podem ter dificuldades para reunir conjuntos de dados de treinamento suficientes. Além disso, a pressão que os aplicativos de GenAI colocam sobre os recursos e a quantidade de manutenção que eles exigem criam mais obstáculos a serem superados.

Práticas recomendadas para a adoção segura da IA generativa

A GenAI é nova para todos, então os líderes devem tomar cuidado em como abordam seu uso dentro de uma organização. Aqui estão algumas das melhores maneiras de proteger seus funcionários e negócios quando se trata de GenAI.

- Avalie e mitigue continuamente os riscos que acompanham as ferramentas baseadas em IA para proteger propriedade intelectual, dados pessoais e informações dos clientes.

- Garanta que o uso de ferramentas de IA esteja em conformidade com as leis e padrões éticos relevantes, incluindo regulamentos de proteção de dados e leis de privacidade.

- Estabeleça responsabilidades claras para o desenvolvimento e implantação de ferramentas de IA, incluindo funções e responsabilidades definidas para supervisionar projetos de IA.

- Mantenha a transparência ao utilizar ferramentas de IA. Justifique a sua utilização e comunique claramente o seu propósito às partes interessadas.

Explore o Relatório de Segurança de IA da Zscaler ThreatLabz de 2024 para obter mais orientações sobre o uso seguro de IA e proteção contra ameaças baseadas em IA.

O futuro da IA generativa na cibersegurança: tendências a serem observadas

Como mencionamos acima, eventualmente começaremos a ver regulamentações de conformidade restringindo o uso da GenAI. Dito isso, a GenAI continuará a inovar, e as equipes de segurança cibernética estarão prontas para aproveitar essas inovações.

Aqui estão algumas das maneiras pelas quais a IA está projetada para ajudar as equipes de segurança e conformidade a ter sucesso:

- Análise de risco geográfico: as empresas eventualmente poderão usar IA para analisar dados geopolíticos e tendências de redes sociais para prever regiões com maior risco de realizar um ataque.

- Biometria comportamental: a análise de padrões no comportamento do usuário, como pressionamentos de teclas e movimentos do mouse, pode ser usada para detectar anomalias que podem indicar atividades maliciosas ou fraudulentas.

- Autenticação de conteúdo: a IA será capaz de verificar a autenticidade de áudio, vídeo (como deepfakes) ou texto para combater a disseminação de informações incorretas.

- Automação de conformidade: a IA será capaz de verificar frequentemente sistemas e processos para garantir que eles atendam a todos os requisitos regulatórios, mesmo enquanto evoluem.

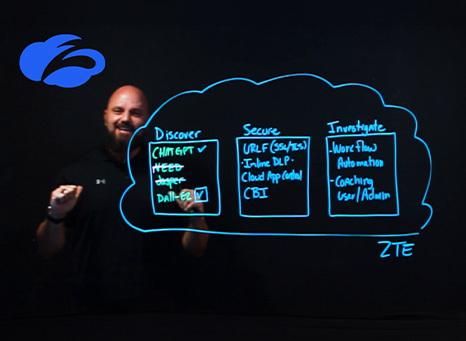

Como a Zscaler protege a IA generativa

A Zscaler Zero Trust Exchange™ permite que você crie e aplique políticas em torno dos sites de IA generativa que seus usuários podem visitar e como eles podem interagir, diretamente ou por meio do isolamento do navegador, para proteger seus dados sigilosos.

Com a Zscaler, seus usuários podem aproveitar com segurança inovações que permitem:

- Entender o uso do ChatGPT: mantenha registros completos que mostram a atividade de uso e os prompts no ChatGPT

- Controlar aplicativos de IA específicos: defina e aplique quais ferramentas de IA seus usuários podem ou não acessar

- Integrar a segurança total dos dados ao uso da IA: garanta que dados sigilsoos nunca vazem por meio de um prompt ou consulta de IA

- Restringir uploads de dados para ferramentas de IA: implemente controles granulares que permitem prompts, mas impedem uploads em lote de dados importantes

Solicite uma demonstração para saber como a Zscaler pode ajudar você a controlar o uso da IA generativa sem colocar seus dados sigilosos em risco.

Confira nossas previsões para a cibersegurança em 2025 e descubra como a GenAI pode ser usada contra você.

Saber mais e explorar recursos

Perguntas frequentes

Perguntas frequentes

Semelhante ao uso de IA generativa em segurança cibernética, o aprendizado de máquina (ML) aliviará a carga das equipes de segurança quando se trata de analisar grandes conjuntos de dados, criar modelos e usar esses modelos para prever com precisão anomalias de tráfego e conteúdo.

Os profissionais de segurança cibernética permanecerão a bordo para ajudar as organizações a manter um ambiente higiênico e em conformidade, mesmo quando a IA começar a assumir a maior parte do trabalho de inteligência e análise de ameaças, entre outras responsabilidades.

Agentes mal-intencionados já estão usando IA generativa para realizar golpes de deepfake, ignorar a autenticação biométrica e detectar vulnerabilidades para eventualmente explorá-las. Aqui está um exemplo recente de uma tentativa de extorsão realizada em Singapura.

O Zscaler Deception e o Zscaler Risk360 aproveitam os recursos da GenAI. O Deception implementa honeypots com tecnologia de IA e emula a infraestrutura de GenAI para enganar ameaças potenciais, e o Risk360 usa GenAI para fornecer informações atualizadas sobre a postura de risco de uma organização e recomendar ações corretivas.

Além disso, a Zscaler também lançará o Breach Predictor, que combina IA preditiva e GenAI para prever violações e aplicar políticas, e o Copilot, um assistente com tecnologia de IA que fornece insights abrangentes sobre a experiência digital dos usuários em uma organização. Saiba mais sobre o Breach Predictor e o Copilot.