/ Qu’est-ce que l’IA générative en matière de cybersécurité ?

Qu’est-ce que l’IA générative en matière de cybersécurité ?

L’IA générative en matière de cybersécurité est un outil puissant tant pour les défenseurs que pour les attaquants. L’IA générative exploite les grands modèles de langage (LLM) qui peuvent aider les équipes de sécurité à améliorer la stratégie, la détection des menaces, la gestion des vulnérabilités et la posture de sécurité globale. Elle peut toutefois également aider les acteurs malveillants à mener des attaques plus rapides et plus dangereuses.

Qu’est-ce que l’IA générative et quel est son lien avec la cybersécurité ?

L’intelligence artificielle générative (GenAI) influence le paysage de la cybersécurité de nombreuses manières. Cependant, avant de nous lancer dans ce sujet, nous devons expliquer de quoi il s’agit et détailler ses cas d’utilisation. À la base, l’IA générative est un type de technologie d’apprentissage automatique qui peut produire du contenu écrit en langage naturel, en images et, dans certains cas, en vidéos, parfois avec une intervention humaine minimale.

Pour la plupart des cas d’utilisation d’IA générative, un utilisateur humain doit demander au moteur d’IA de créer le contenu en question, à quelques exceptions près pour les technologies d’entreprise avancées. Un utilisateur pourrait par exemple entrer : « Écris une histoire sur une cyberattaque d’IA générative » dans un générateur de texte, et le LLM produira rapidement cette histoire. Il en va de même pour les images : dites à un générateur d’images IA de « créer une image d’un data center futuriste », et il fera exactement cela.

L’IA générative permet une infinité d’utilisations pour les professionnels de tous les secteurs, aidant les utilisateurs quotidiens à innover et à accroître l’efficacité de leur création de contenu. Cela dit, dans le cadre de cet article, nous nous intéresserons uniquement à l’IA générative dans son rapport avec la cybersécurité.

Comment l’IA générative peut-elle être utilisée en matière de cybersécurité ?

L’IA générative peut être utilisée pour contribuer aux efforts de cybersécurité défensifs et offensifs. Les entreprises peuvent déployer des plateformes d’IA générative de cybersécurité pour :

- Protéger vos données sensibles encore plus efficacement : empêchez les fuites de données tout en conservant les invites d’IA et la sortie des applications d’IA à des fins de sécurité et d’audits.

- Renforcer la sécurité contre les menaces émergentes : adoptez une posture de sécurité plus proactive, dans la mesure où l’IA aide à détecter et à bloquer les attaques émergentes basées sur le Web et les fichiers.

- Assurer une utilisation sécurisée d’outils comme ChatGPT : bénéficiez d’un contrôle granulaire sur l’utilisation des applications d’IA avec la possibilité de définir différentes politiques pour différents utilisateurs.

- Limiter les actions risquées dans les applications d’IA : empêchez les actions qui mettent les données en danger, comme les chargements, les téléchargements et les actions de copier/coller.

Quelles sont les implications de l’IA en matière de cybersécurité ?

L’utilisation de ChatGPT a augmenté de 634 % (avril 2023 - janvier 2024), ce qui signifie que son influence s’étendra à davantage de secteurs, et notamment à la cybersécurité. L’essentiel de la cybersécurité étant basé sur le contenu (c’est-à-dire les cybermenaces et attaques potentielles provenant du trafic Web, des e-mails, etc.), les grands modèles de langage seront préparés à analyser les informations concernant le trafic et les e-mails afin d’aider les entreprises à prévoir et à prévenir les cybermenaces.

Cela étant dit, les équipes de sécurité devront être prêtes à combattre le feu par le feu. Les acteurs et groupes de menace décideront également d’utiliser l’IA générative pour prendre l’ascendant sur les cyberdéfenses des entreprises. Selon Microsoft, les cyberattaques générées par l’IA en sont à un « stade précoce » et « ne sont ni particulièrement nouvelles ni particulièrement uniques ». OpenAI s’efforce de neutraliser ces acteurs en fermant leurs comptes, mais le nombre de groupes de menace ne cessant de croître, ces comptes seront plus difficiles à repérer et à fermer.

De plus, les gouvernements mondiaux ne vont plus tarder à intervenir et à établir des lignes directrices concernant l’utilisation de l’IA générative au niveau des entreprises. Pour l’instant, de nombreuses inconnues demeurent en ce qui concerne l’IA générative, mais à terme, une violation ou une fuite de données pourrait survenir et coûter des millions de dollars à une ou plusieurs entreprises, obligeant le gouvernement à intervenir et à imposer des réglementations.

Les 4 principaux avantages de l’IA générative en cybersécurité

Avec l’approche adéquate, l’IA générative peut apporter de considérables avantages à une entreprise en ce qui concerne la détection et la réponse aux cybermenaces, l’automatisation de la sécurité, et bien plus encore.

Amélioration de la détection et de la réponse aux menaces

L’IA générative peut analyser les données dont le comportement est « normal » pour établir une base de référence permettant d’identifier les écarts révélateurs de menaces potentielles. L’IA peut également générer des simulations d’un malware pour comprendre son comportement et identifier de nouvelles menaces.

Meilleures capacités prédictives

L’IA générative peut ingérer de grandes quantités de données pour créer un cadre de référence relatif aux futurs événements de sécurité, permettant ainsi une veille prédictive des menaces et même une gestion des vulnérabilités.

Automatisation des tâches répétitives

L’IA générative peut prédire les vulnérabilités et recommander ou automatiser des correctifs pour les applications sur la base des données historiques relatives à ces dernières. Elle peut également automatiser la réponse aux incidents, réduisant ainsi le recours à une intervention humaine.

Prévention du phishing

L’IA générative peut vous aider à créer des modèles qui détectent et filtrent les e-mails de phishing en analysant les modèles et les structures de langage pour identifier les e-mails qui tentent de dissimuler de telles attaques. Elle peut également créer des modèles afin d’analyser et bloquer les URL malveillantes.

Défis et risques liés à l’intégration de l’IA générative

L’IA générative offre un potentiel sans précédent pour la création de contenu et l’efficacité organisationnelle au sens large, mais il est également important de comprendre les obstacles liés à cette technologie.

Utilisation abusive par les cybercriminels

Les outils d’IA générative sont accessibles à tous et à toutes, et tandis que les entreprises bien intentionnées les utiliseront pour accroître leur efficacité ou améliorer leur cybersécurité, les acteurs malveillants s’en serviront tout aussi bien pour nuire. Microsoft et OpenAI ont d’ores et déjà découvert des tentatives de groupes malveillants visant à « organiser des opérations de cyberattaque ».

Problèmes de qualité des données

Les entreprises qui ne sont pas en mesure de fournir des données de haute qualité pour l’entraînement d’une plateforme d’IA connaîtront un manque d’efficacité en termes de résultats liés à leur utilisation de la plateforme. De plus, si une entreprise tente d’entraîner une plateforme d’IA générative à l’aide de données créées par l’IA générative, les données résultantes seront encore plus confuses, et synonyme de désastre en matière de cybersécurité.

Limitations techniques

Les modèles d’IA génératives exigent de grandes quantités de données pour s’entraîner de manière efficace. Par conséquent, les entreprises ayant un accès limité aux données, ou celles opérant sur des marchés de niche, peuvent avoir du mal à rassembler des ensembles de données d’apprentissage suffisants. En outre, la pression que les applications d’IA générative exercent sur les ressources et le degré de maintenance qu’elles requièrent créent davantage d’obstacles à surmonter.

Bonnes pratiques pour une adoption sécurisée de l’IA générative

L’IA générative est une nouvelle technologie pour tout le monde. Les dirigeants doivent donc faire attention à la manière dont ils abordent son utilisation au sein de leur entreprise. Voici quelques-unes des meilleures façons de protéger vos employés et votre entreprise face à l’IA générative.

- Évaluez et atténuez en permanence les risques liés aux outils optimisés par l’IA afin de protéger la propriété intellectuelle, les données personnelles et les informations des clients.

- Veillez à ce que l’utilisation des outils d’IA soit conforme à toutes les lois et normes éthiques pertinentes, notamment les réglementations concernant la protection des données et les lois sur la confidentialité.

- Établissez des responsabilités claires pour le développement et le déploiement d’outils d’IA, notamment des rôles et des responsabilités définis pour la supervision des projets d’IA.

- Maintenez la transparence lorsque vous utilisez des outils d’IA, justifiez leur utilisation et communiquez clairement leur objectif aux parties prenantes.

Consultez le rapport Zscaler ThreatLabz 2024 sur la sécurité optimisée par l’IA pour obtenir plus de conseils sur l’utilisation sécurisée de l’IA et la protection contre les menaces basées sur l’IA.

L’avenir de l’IA en cybersécurité : tendances à surveiller

Comme nous l’avons mentionné plus haut, nous commencerons finalement à voir des réglementations de conformité peser sur l’utilisation de l’IA générative. Cela étant dit, l’IA générative continuera d’innover et les équipes de cybersécurité ne manqueront pas de tirer parti de ces innovations.

Voici quelques-unes des façons dont l’IA devrait aider les équipes de sécurité et de conformité à mener à bien leur mission :

- Analyse des risques géographiques : les entreprises pourront à terme utiliser l’IA pour analyser les données géopolitiques et les tendances des réseaux sociaux afin de prévoir les régions présentant un risque plus élevé de mener une attaque.

- Biométrie comportementale : l’analyse des modèles de comportement des utilisateurs, tels que les frappes au clavier et les mouvements de la souris, peut être utilisée pour détecter des anomalies pouvant indiquer une activité malveillante ou frauduleuse.

- Authentification du contenu : l’IA sera capable de vérifier l’authenticité des fichiers audio, vidéo (comme les deepfakes) ou texte pour contrer la propagation de fausses informations.

- Automatisation de la conformité : l’IA sera capable d’analyser régulièrement les systèmes et les processus pour s’assurer qu’ils répondent à toutes les exigences réglementaires, même lorsqu’elles évoluent.

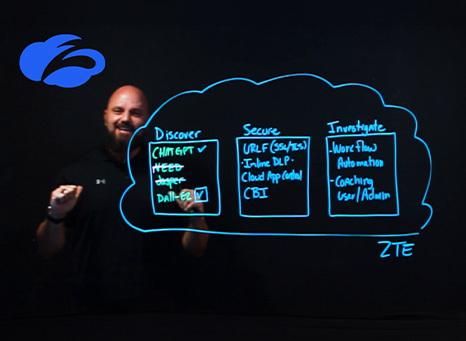

Comment Zscaler sécurise l’IA générative

Zscaler Zero Trust Exchange™ vous permet de créer et d’appliquer des politiques autour des sites d’IA générative auxquels vos utilisateurs peuvent accéder et de la manière dont ils peuvent interagir, directement ou via l’isolation du navigateur, pour protéger vos données sensibles.

Avec Zscaler, vos utilisateurs peuvent exploiter en toute sécurité des innovations qui vous permettent de :

- Comprendre l’utilisation de ChatGPT : conservez des journaux complets qui montrent l’activité d’utilisation et les invites dans ChatGPT.

- Contrôler des applications d’IA spécifiques : définissez les outils d’IA auxquels vos utilisateurs peuvent et ne peuvent pas accéder.

- Intégrer la sécurité complète des données dans l’utilisation de l’IA : assurez-vous que les données sensibles ne fuient jamais via une invite ou une requête d’IA.

- Restreindre les chargements de données vers les outils d’IA : mettez en place des contrôles granulaires qui autorisent les requêtes, mais empêchent le chargement en masse de données importantes.

Demandez une démo pour découvrir comment Zscaler peut vous aider à contrôler l’utilisation de l’IA générative sans mettre en danger vos données sensibles.

Consultez nos prévisions concernant la cybersécurité en 2025 et découvrez comment l’IA générative pourrait être utilisée contre vous.

Découvrir et explorer les ressources

FAQ

À l’instar de l’utilisation de l’IA générative en matière de cybersécurité, l’apprentissage automatique (AA) soulagera les équipes de sécurité lorsqu’il s’agira d’analyser de grands ensembles de données, de créer des modèles et d’utiliser ces modèles pour prédire avec précision les anomalies de trafic et de contenu.

Les professionnels de la cybersécurité continueront à être impliqués dans le maintien d’un environnement sain et conforme pour les entreprises, même si l’IA commence à prendre en charge le gros du travail de renseignement et d’analyse des menaces, entre autres responsabilités.

Les acteurs malveillants utilisent déjà l’IA générative pour mener des escroqueries par deepfake, contourner l’authentification biométrique et détecter des vulnérabilités à exploiter ultérieurement. Voici un exemple récent de tentative d’extorsion mené à Singapour.

Zscaler Deception et Zscaler Risk360 exploitent les capacités de l’IA générative. Deception déploie des honeypots optimisés par l’IA et émule l’infrastructure d’IA générative pour leurrer les menaces potentielles. Risk360 utilise l’IA générative pour fournir des informations actualisées sur la posture de risque d’une entreprise et recommande des mesures correctives.

Au-delà de cela, Zscaler lancera également Breach Predictor, combinant l’IA prédictive et l’IA générative pour prédire les violations et appliquer les politiques, et Copilot, un assistant optimisé par l’IA qui fournit des informations complètes sur l’expérience numérique des utilisateurs à l’échelle de l’entreprise. En savoir plus sur Breach Predictor et Copilot.