/ Welche Rolle spielt generative KI in der Cybersicherheit?

Welche Rolle spielt generative KI in der Cybersicherheit?

Generative KI ist ein leistungsstarkes Werkzeug sowohl für Cybersicherheitsexperten als auch für Angreifer. Generative KI unterstützt Large Language Models (LLMs), die Sicherheitsteams dabei helfen können, Richtlinien, Bedrohungserkennung, Schwachstellenmanagement sowie den allgemeinen Sicherheitsstatus zu verbessern. Allerdings kann sie Bedrohungsakteuren auch dabei helfen, schnellere und gefährlichere Angriffe zu starten.

Wissenswertes zu GenAI

Generative künstliche Intelligenz (GenAI) wirkt sich in mehrfacher Hinsicht auf die Cybersicherheitslage aus. Im Kern ist generative KI eine Form von maschineller Lerntechnologie, die schriftliche Inhalte in natürlicher Sprache, Bilder und in einigen Fällen auch Videos erstellen kann – teilweise mit nur minimalem menschlichen Input.

Bei den meisten Anwendungsfällen von GenAI muss ein menschlicher User die KI-Engine auffordern, den betreffenden Inhalt zu erstellen. Für fortgeschrittene Unternehmenstechnologien gelten einige Ausnahmen. Beispielsweise könnte ein Mensch die Aufforderung „Eine Geschichte über einen GenAI-Cyberangriff schreiben“ in einen Textgenerator eingeben, und das LLM erstellt schnell eine solche Geschichte. Dasselbe gilt für Bilder: Sagen Sie einem KI-Bildgenerator, er solle „ein Bild eines futuristischen Rechenzentrums erstellen“, und er wird genau das tun.

GenAI ermöglicht Fachleuten aller Branchen eine Vielzahl von Anwendungsfällen und erschließt Laien neue Möglichkeiten, die Effizienz bei der Inhaltserstellung zu steigern. In diesem Beitrag geht es konkret um die Anwendung von GenAI in der Cybersicherheit.

Wie wird generative KI in der Cybersicherheit eingesetzt?

Generative KI kann sowohl zur Unterstützung defensiver als auch offensiver Cybersicherheitsmaßnahmen eingesetzt werden. Konkret bietet der Einsatz von GenAI-Plattformen in der Cybersicherheit u. a. folgende Vorteile:

- Effektiver Schutz für vertrauliche Daten: Verhindern Sie Datenlecks, während Sie KI-Eingabeaufforderungen und KI-Anwendungen für Sicherheit und Audits nutzen.

- Stärkung der Sicherheit gegen neue Bedrohungen: Stärken Sie den proaktiven Sicherheitsstatus, da KI dabei hilft, neue web- und dateibasierte Angriffe zu erkennen und zu blockieren.

- Sichere Nutzung von Tools wieChatGPT: Gewährleisten Sie granulare Kontrolle über die Nutzung von KI-Anwendungen mit der Möglichkeit, unterschiedliche Richtlinien für unterschiedliche User festzulegen.

- Verhindern riskanter Aktivitäten in KI-Apps:Schränken Sie Aktivitäten ein, die Daten gefährden, wie Uploads, Downloads und Kopieren/Einfügen.

Welche Auswirkungen hat KI auf die Cybersicherheit?

Im Zeitraum von April 2023 bis Januar 2024 hat die Nutzung von ChatGPT um 634 % zugenommen . Das bedeutet, dass sein Einfluss auf weitere Branchen, einschließlich der Cybersicherheit, übergreifen wird. Da Cybersicherheit primär auf Inhalte fokussiert ist (d. h. auf potenzielle Cyberbedrohungen und -angriffe, die über den Internetverkehr, E-Mails usw. erfolgen), werden LLMs dafür trainiert, Informationen zum Datenverkehr und zu E-Mails zu analysieren und so Organisationen bei der Vorhersage und Verhinderung von Cyberereignissen zu unterstützen.

Zugleich müssen Sicherheitsteams sich des potenziellen Risikos bewusst sein, das durch GenAI-gestützte Angriffe entsteht. Bedrohungsakteure und -gruppen werden GenAI nutzen, um die Oberhand über die Cyberabwehr von Organisationen zu gewinnen. Laut Microsoft befinden sich KI-generierte Cyberangriffe derzeit noch im „Frühstadium“ und sind „weder besonders innovativ noch erfinderisch“. Um solchen Akteuren das Handwerk zu legen, sperrt OpenAI deren Konten. Da die Zahl der Bedrohungsgruppen jedoch weiter steigt, wird es immer schwieriger, diese Konten aufzuspüren und zu schließen.

Darüber hinaus ist es nur eine Frage der Zeit, bis die zuständigen Behörden weltweit eingreifen und auf organisatorischer Ebene Richtlinien für den Einsatz von GenAI festlegen. Rund um GenAI bestehen derzeit noch zahlreiche offene Fragen. Jedoch ist damit zu rechnen, dass es früher oder später zu einer Datenschutzverletzung oder einem Datenleck kommt, das einem oder mehreren Unternehmen Millionen von Dollar kostet und die Behörden zum Eingreifen und Regulieren zwingt.

4 Vorteile von generativer KI in der Cybersicherheit

Mit dem richtigen Ansatz bietet GenAI Organisationen erhebliche Vorteile u. a. bei der Erkennung und Reaktion auf Cyberbedrohungen und der Automatisierung von Sicherheit.

Verbesserte Bedrohungserkennung und -reaktion

Generative KI kann Daten analysieren, die ein „normales“ Verhalten repräsentieren, um eine Baseline festzulegen, anhand derer Abweichungen identifiziert werden können, die auf potenzielle Bedrohungen hinweisen. Darüber hinaus kann KI Malware-Simulationen erstellen, um deren Verhalten zu verstehen und neue Bedrohungen zu identifizieren.

Verbesserte Vorhersagefähigkeiten

Generative KI kann große Datenmengen verarbeiten, um einen Referenzrahmen für zukünftige Sicherheitsereignisse zu erstellen und so prädiktive Bedrohungsinformationen und sogar Schwachstellenmanagement zu ermöglichen.

Automatisierung von Routineaufgaben

GenAI kann Schwachstellen vorhersagen und basierend auf Verlaufsdaten Patches für Anwendungen empfehlen oder automatisieren. Darüber hinaus kann die Reaktion auf Vorfälle automatisiert werden, wodurch die Notwendigkeit menschlicher Eingriffe reduziert wird.

Phishing-Prävention

GenAI kann die Erstellung von Modellen unterstützen, die Phishing-E-Mails erkennen und herausfiltern, indem sie Sprachmuster und -strukturen analysiert, um verdächtige E-Mails zu identifizieren. Sie kann auch Modelle zum Analysieren und Blockieren schädlicher URLs erstellen.

Herausforderungen und Risiken

GenAI bietet ein beispielloses Potenzial für die Inhaltserstellung und die organisatorische Effizienz im Allgemeinen. Dennoch ist es wichtig, auch die Hürden der Technologie zu verstehen.

Missbrauch durch Cyberkriminelle

GenAI-Tools stehen allen Usern zur Verfügung. Während Organisationen sie nutzen, um ihre Effizienz zu steigern oder ihre Cybersicherheit zu verbessern, setzen Bedrohungsakteure sie ein, um Schaden anzurichten. Microsoft und OpenAI haben bereits Versuche von Bedrohungsgruppen entdeckt, „offensive Cyberoperationen zu organisieren“.

Probleme mit der Datenqualität

Organisationen, die nicht in der Lage sind, qualitativ hochwertige Daten für das Training einer KI-Plattform bereitzustellen, werden feststellen, dass die Ergebnisse, die sie durch die Nutzung der Plattform erzielen, nicht effektiv sind. Wenn ein Unternehmen versucht, eine GenAI-Plattform mit von GenAI erstellten Daten zu trainieren, werden die resultierenden Daten noch stärker verfälscht – damit sind katastrophale Folgen für die Cybersicherheit quasi vorprogrammiert.

Technische Einschränkungen

Für das effektive Training generativer KI-Modelle sind große Datenmengen erforderlich. Daher kann es für Unternehmen mit eingeschränktem Datenzugriff oder solche in Nischenmärkten schwierig sein, ausreichend Trainingsdatensätze zu sammeln. Hinzu kommen die hohe Ressourcenbelastung und der Wartungsaufwand, die GenAI-Anwendungen erfordern.

Best Practices

GenAI ist für alle neu, daher müssen Führungskräfte bei der Vorgehensweise hinsichtlich der Nutzung innerhalb einer Organisation vorsichtig sein. Im Folgenden stellen wir einige der besten Möglichkeiten vor, Ihre Mitarbeiter und Ihr Unternehmen vor Risiken im Zusammenhang mit GenAI zu schützen.

- Bewerten und kontrollieren Sie kontinuierlich KI-bezogene Risiken, um geistiges Eigentum, personenbezogene Daten und Kundeninformationen zu schützen.

- Gewährleisten Sie bei der Verwendung von KI-Tools die Einhaltung einschlägiger Gesetze und ethischer Standards, insbesondere hinsichtlich Vorschriften für die Data Protection.

- Legen Sie klare Verantwortlichkeiten für die Entwicklung und Bereitstellung von KI-Tools fest, insbesondere eindeutig definierte Rollen und Zuständigkeiten für die Überwachung von KI-Projekten.

- Sorgen Sie beim Einsatz von KI-Tools für Transparenz, indem Sie gegenüber Stakeholdern deren Verwendung begründen und ihren Zweck klar kommunizieren.

Weitere Hinweise zur sicheren Nutzung von KI und zum Schutz vor KI-basierten Bedrohungen finden Sie im Report von Zscaler ThreatLabz zur KI-Sicherheit 2024.

Die Zukunft der KI in der Cybersicherheit

Wie bereits angesprochen, ist davon auszugehen, dass der Einsatz von GenAI früher oder später durch aufsichtsrechtliche Vorschriften eingeschränkt wird. Dennoch wird GenAI weiterhin Neuerungen einführen und die Cybersicherheitsteams werden sich diese Neuerungen zunutze machen.

Dies sind einige der Möglichkeiten, wie KI Sicherheits- und Compliance-Teams unterstützen kann:

- Georisikoanalyse: Unternehmen werden KI zur Analyse geopolitischer Daten und Social-Media-Trends nutzen können, um Regionen mit einem höheren Angriffsrisiko vorherzusehen.

- Verhaltensbiometrie: Durch die Analyse von Mustern im Userverhalten, beispielsweise Tastenanschlägen und Mausbewegungen, können Anomalien erkannt werden, die auf böswillige oder betrügerische Aktivitäten hinweisen können.

- Inhaltsauthentifizierung: KI wird in der Lage sein, die Authentizität von Audio- und Videodateien (wie Deepfakes) oder Texten zu überprüfen, um der Verbreitung von Fehlinformationen entgegenzuwirken.

- Compliance-Automatisierung: Mithilfe von KI können Systeme und Prozesse regelmäßig überprüft werden, um sicherzustellen, dass sie auch bei weiterer Entwicklung alle gesetzlichen Anforderungen erfüllen.

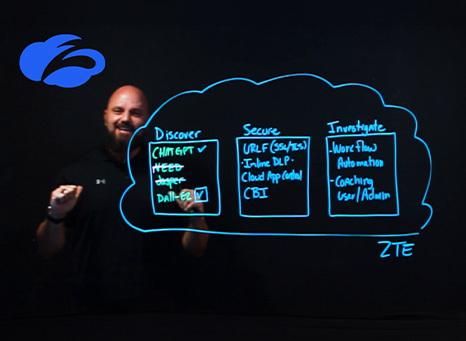

Sichere generative KI mit Zscaler

Mit der Zscaler Zero Trust Exchange™ können Sie Richtlinien für die generativen KI-Sites erstellen und durchsetzen, die Ihre User besuchen können, sowie für den Einsatz von Browserisolierung zur Vermittlung von Interaktionen, um Ihre vertraulichen Daten zu schützen.

Mit Zscaler können Ihre User Innovationen sicher nutzen, die Ihnen Folgendes ermöglichen:

- ChatGPT-Nutzung verstehen: Führen Sie lückenlose Protokolle, die Nutzungsaktivitäten und Eingabeaufforderungen in ChatGPT zeigen

- Verwendung von KI-Anwendungen kontrollieren: Definieren und erzwingen Sie, auf welche KI-Tools Ihre Benutzer zugreifen können und auf welche nicht

- Umfassende Datensicherheit in die KI-Nutzung integrieren: Stellen Sie sicher, dass vertrauliche Daten niemals durch eine KI-Eingabeaufforderung oder -Abfrage verloren gehen können

- Hochladen von Daten in KI-Tools einschränken: Implementieren Sie granulare Kontrollen, die Eingabeaufforderungen zulassen, aber Massen-Uploads wichtiger Daten verhindern.

Fordern Sie eine Demo an, um zu erfahren, wie Zscaler Ihre Organisation dabei unterstützen kann, den Einsatz generativer KI zu kontrollieren, ohne Ihre vertraulichen Daten zu gefährden.